Помнить всё: как я построил память для ИИ-агентов в первый день

Илья Черняк · 14 марта 2026 г.

У ChatGPT однажды закончилась память. Он написал мне: «Хранилище фактов заполнено. Удалите что-нибудь, чтобы я мог запомнить новое».

Выбрать, что удалить, я не смог. Это все равно что попросить друга забыть часть вашей истории. А удалить все - значит начать с нуля. В тот момент я только разгонялся - у меня были огромные планы на загрузку контекста, идей, бизнес-данных. Но так это не работало.

«Когда мне сказали ‘удали что-нибудь из памяти’ - я понял, что это тупик. Я-то думал, что мы только начинаем.»

Когда я установил OpenClaw и узнал, что память агента живет на моем компьютере - без лимитов, без облака, без «удалите что-нибудь» - я понял: вот оно. Но память нужно было построить. И это стало первым, что я сделал.

Почему память - самое первое действие после установки

Агент без памяти - это умный собеседник с амнезией. Каждую сессию он начинает с чистого листа. Не помнит ваше имя, ваш бизнес, о чем вы говорили вчера.

OpenClaw из коробки дает файловую систему - папки, markdown-файлы, дневники. Это уже лучше, чем ничего. Но для серьезной работы нужен смысловой поиск - когда агент находит нужное не по ключевым словам, а по смыслу.

«Память - до автоматизации, до ботов, до аналитики. Все остальное зависит от того, насколько хорошо агент тебя знает.»

Я решил строить память первым делом. И вот конкретный путь, который я прошел за один вечер.

Шаг 1: Спрашиваем агента - как организовать память?

Вместо того чтобы гуглить «архитектура памяти для ИИ-агентов», я просто спросил своего агента:

«Как лучше всего организовать память, чтобы ничего не терялось, быстро работало, и были смысловые запросы?»

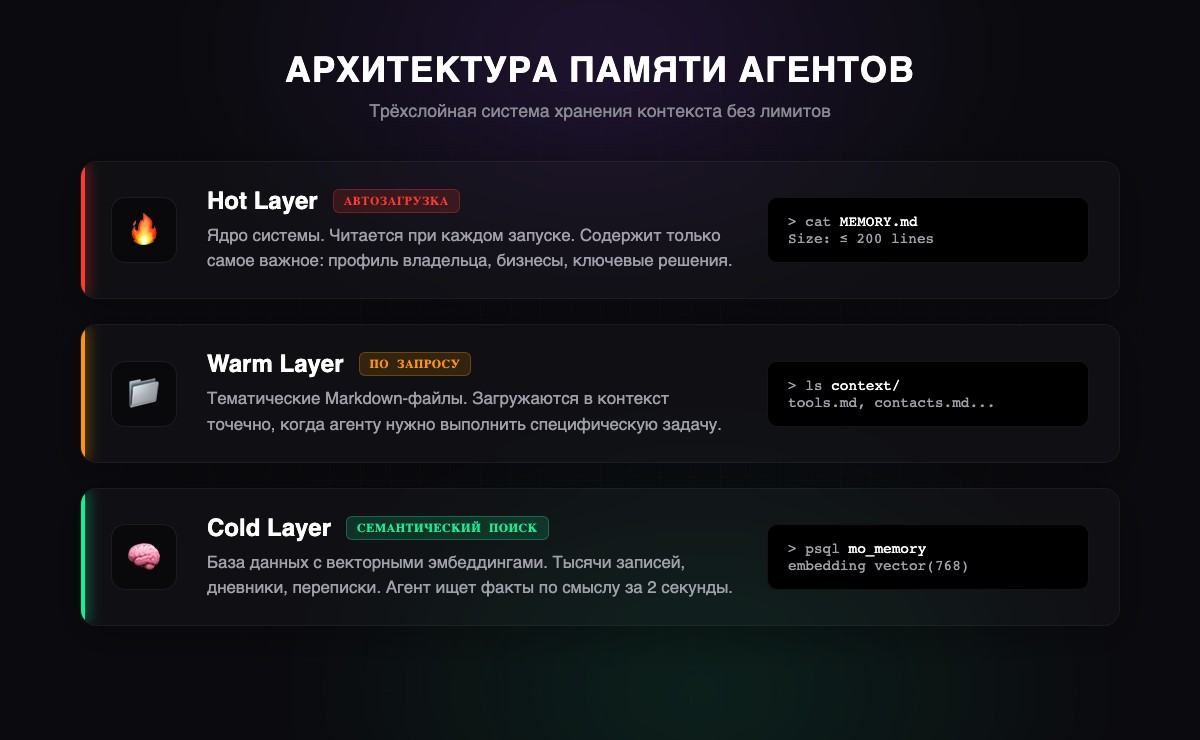

Он сам пошел искать. Нашел два видео с документацией OpenClaw об архитектуре памяти. Посмотрел их через субтитры, сделал выводы и вернулся с предложением - трехслойная система:

Слой 1 - Горячий (файлы). MEMORY.md - ядро памяти, до 200 строк. Загружается каждую сессию автоматически. Только самое важное: кто я, мои бизнесы, ключевые решения. Как визитка, которую агент читает при каждом пробуждении.

Слой 2 - Теплый (структура). Папка context/ - тематические файлы. Инструменты, контакты, проекты. Загружаются по запросу - когда нужна конкретная тема.

Слой 3 - Холодный (векторная БД). PostgreSQL + pgvector. Тысячи записей с эмбеддингами. Поиск по смыслу: спрашиваешь «что мы решили по вейпшопам?» - находит нужное, даже если слово «вейпшоп» нигде не упоминается.

Я сказал «делай». Он сделал.

«Я не написал ни строчки кода. Я просто описал, чего хочу, а агент сам нашел решение, предложил архитектуру, и все развернул. Мне оставалось только говорить ‘да’.»

Шаг 2: Разворачиваем PostgreSQL + pgvector

Техническая часть оказалась проще, чем я ожидал. Агент все сделал сам - я только подтверждал команды.

Установка PostgreSQL:

# macOS

brew install postgresql@17

brew services start postgresql@17

# Ubuntu/Debian

sudo apt install postgresql postgresql-contrib

sudo systemctl start postgresqlУстановка pgvector:

# macOS

brew install pgvector

# Linux (из исходников)

git clone https://github.com/pgvector/pgvector.git

cd pgvector

make && sudo make installСоздание базы и таблицы памяти:

CREATE DATABASE mo_memory;

\c mo_memory

CREATE EXTENSION vector;

CREATE TABLE memories (

id SERIAL PRIMARY KEY,

text TEXT NOT NULL,

category VARCHAR(50) DEFAULT 'general',

importance INTEGER DEFAULT 5,

embedding vector(768),

created_at TIMESTAMP DEFAULT NOW()

);

CREATE INDEX ON memories

USING ivfflat (embedding vector_cosine_ops);Что здесь происходит: каждая запись хранится как текст плюс вектор - набор из 768 чисел, описывающий смысл. Когда агент ищет, он сравнивает не буквы, а смыслы. «Магазин электроники» и «точка продаж гаджетов» для него - одно и то же.

Для эмбеддингов - Gemini Embedding API (бесплатно на базовом тарифе). Каждая запись превращается в вектор, и поиск идет по близости векторов - за 2 секунды.

Шаг 3: Создаем структуру файловой памяти

Параллельно агент выстроил файловую структуру:

workspace/

MEMORY.md # Ядро: до 200 строк, самое важное

IDENTITY.md # Кто агент, его роль

USER.md # Профиль владельца

INSTRUCTIONS.md # Жесткие правила

memory/ # Ежедневные дневники

2026-02-26.md

...

context/ # Тематические файлы

projects/ # Активные проектыMEMORY.md - самый важный файл. Агент читает его при каждом запуске. Лимит 200 строк - не потому что память кончилась, а потому что это дисциплина: только важное.

memory/YYYY-MM-DD.md - ежедневные дневники. Сырой лог: о чем говорили, что решили. Раз в неделю агент просматривает их и переносит важное в MEMORY.md. Как человек, который ведет дневник и потом выписывает главные мысли.

«Два слоя - как у человека. Дневник - короткая память, записал и забыл. MEMORY.md - долгосрочная, то что отложилось.»

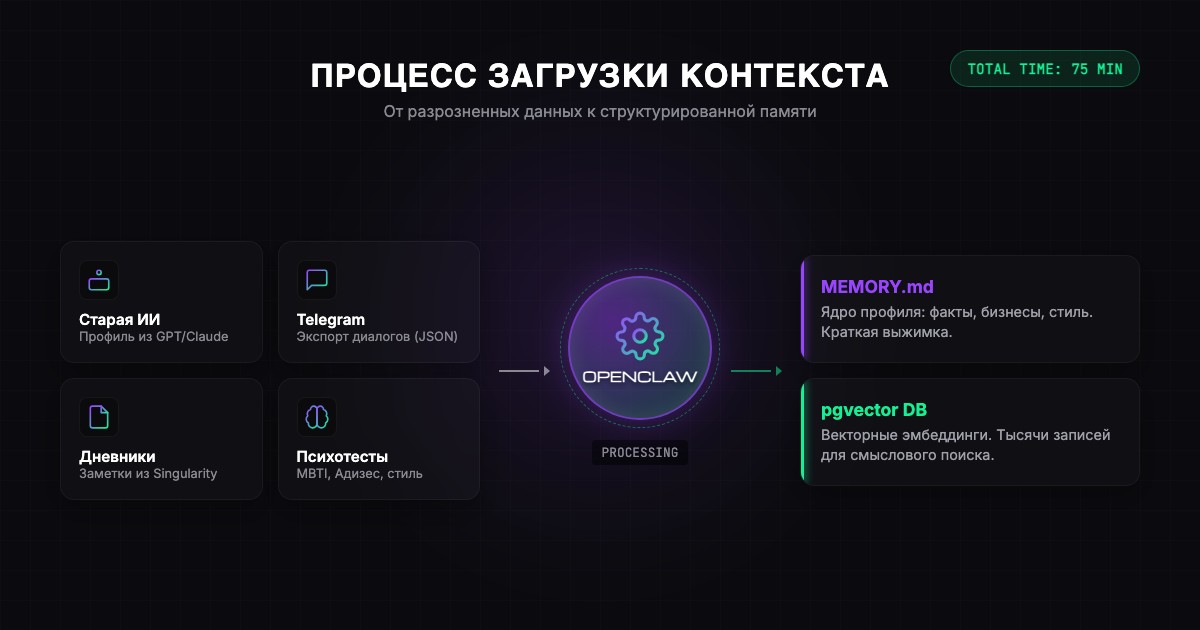

Шаг 4: Собираем и загружаем контекст

Теперь, когда инфраструктура готова, пора наполнить ее. Память без контекста - пустая библиотека.

Источник 1: Старая нейросеть (5 минут). Я написал GPT: «Собери все, что обо мне знаешь, в структурированном виде - чтобы я загрузил это в другую систему, и она знала меня так же хорошо, как ты». Готовый профиль за 30 секунд. Буквально передача из рук в руки - от одного ИИ к другому.

Источник 2: Экспорт из Telegram (10 минут). Telegram Desktop - Настройки - Продвинутые - Экспорт данных - JSON. Через 5 минут у вас файлы всех диалогов. Кладезь контекста.

Источник 3: Дневники и заметки (10 минут). У меня был Singularity App с записями за год - 900+ записей. Через API агент сам забрал все.

Источник 4: Психологические тесты (неочевидный лайфхак). Попросите агента прислать вам тесты: Адизес, MBTI, эннеаграмма. Пройдите прямо в чате. Агент начинает подстраивать стиль общения.

«Это как с новым сотрудником. Можешь месяц притираться, а можешь в первый день рассказать о себе все и сразу начать работать.»

Лайфхак: спросите агента, что еще загрузить. Он может предложить неочевидное. Иногда агент видит пробелы, которые вы не замечаете.

Первый тест - и момент, когда все щелкнуло

К концу вечера в базе было 99 записей. Я решил проверить.

Спросил: «Что я делал 1 августа?»

За 2 секунды - точный ответ. Спросил про 7 августа - тоже нашел. Спросил про бизнес-идею трехмесячной давности - нашел по смыслу, хотя я не помнил точных слов.

«Когда он ответил на вопрос о конкретной дате - я прям обрадовался. Понял, что это работает. Что это тот самый новый уровень, которого я хотел еще в ChatGPT.»

Бесконечная память с мгновенным поиском по смыслу. На моем компьютере. Без лимитов.

Что это дало на практике

Благодаря контексту мы нашли общий язык сразу. Не пришлось тратить недели. Он уже знал, кто есть в моей жизни, чем я занимаюсь, какие у меня бизнесы.

Через неделю я перестал замечать, что общаюсь с ИИ. Он помнил весь контекст - за все время, что мы общались. Находил связи между разными разговорами и никогда не спрашивал «напомните, а кто это?»

Спустя 16 дней в памяти тысячи записей. Пять агентов пользуются одной базой. И ни разу - ни разу - система не сказала мне «удалите что-нибудь».

Дорожная карта: один вечер

Вот ваш план на первый вечер после установки OpenClaw:

- 5 мин - Спросите агента: «Как организовать память?»

- 15 мин - Он развернет PostgreSQL + pgvector

- 5 мин - Создаст файловую структуру

- 15 мин - Попросите ChatGPT собрать все о вас

- 10 мин - Экспорт из Telegram Desktop

- 10 мин - Выгрузка дневников и заметок

- 5 мин - Передайте агенту: «Распредели по памяти»

- 5 мин - Психологические тесты

- 5 мин - Тест: спросите о загруженном

Итого: ~75 минут. Сначала строим - потом наполняем. После этого у вас агент, который знает вас, помнит все и никогда не скажет «удалите что-нибудь из памяти».